-

'설명하는 AI' 개발의 녹내장 진단을 실시하여카테고리 없음 2021. 5. 23. 06:30

- 병변 위치뿐만 아니라 진단된 의학적 소견 제시 - 적대적 설명 방법론을 적용하여 우수한 임상적 활용도 갖추고

병변 위치뿐만 아니라 진단하는 의학적 소견까지 보여주는 새로운 녹내장 진단 설명 가능 AI(eXplainable AI, XAI)가 개발되었습니다.

서울대병원은 30일 안과 박상민 가정의학과 연구팀이 안과 의사가 녹내장을 진단할 때 임상적으로 해석할 수 있는 새로운 설명가능 AI를 개발했다고 발표했습니다.

녹내장은 실명을 일으키는 대표적인 안과 질환으로 특별한 증상 없이도 진행될 수 있어 치료시기를 놓치면 회복이 어려울 뿐만 아니라 치료비도 급격히 상승하는 질환입니다. 그렇기 때문에 무엇보다도 정확한 진단으로 조기 치료가 중요합니다.

연구팀은 서울대학교병원 건강증진센터 환자 코호트의 안저 사진 6천 장을 3회 중복하여 정밀판독하여 녹내장 진단을 위한 인공지능을 학습시켰습니다. 이후 녹내장 진단을 내리는 과정을 설명하기 위해 완성된 인공지능에는 "적대적 설명(Adversarial Explanation) 방법론"이 적용되었습니다.

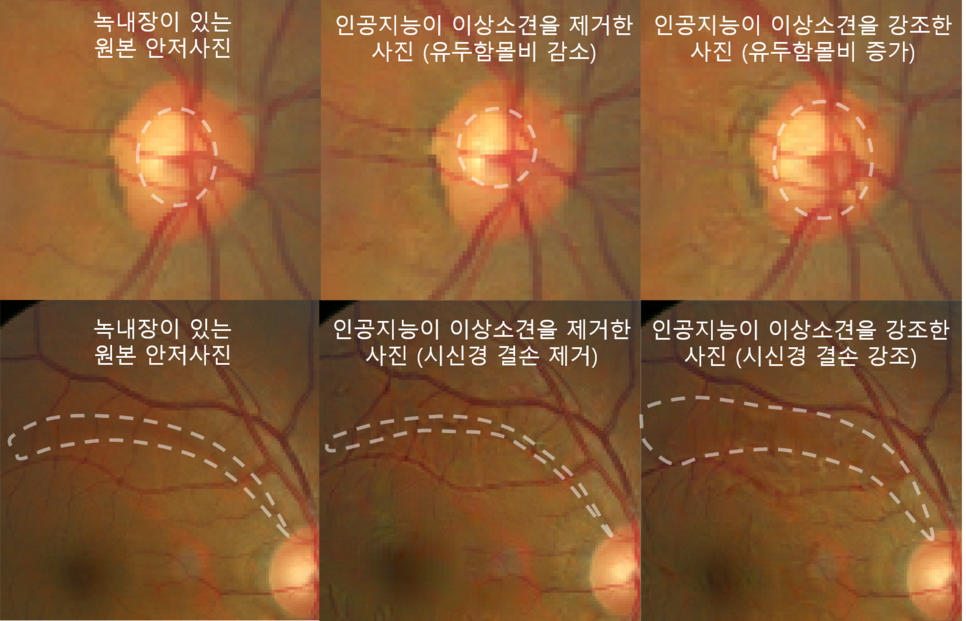

원본 안저사진(왼쪽)과 적대적 설명방법론을 적용하여 생성된 안저사진(가운데,오른쪽) 적대적인 설명 방법론은 인공 지능이 안저 사진을 녹내장이라고 판단하도록 변형시킨 적대적인 예제를 생성합니다. 이 때 적대적인 예제에 녹내장 소견을 추가 강조하고 있음을 의사가 확인함으로써 인공지능의 녹내장 이해도를 확인할 수 있습니다. 반대로 인공지능이 정상적으로 판단하는 적대적인 예제를 생성하여 실제 녹내장 소견이 제거되었는지 확인할 수 있습니다.

적대적 설명 방법론을 적용하여 설명 가능한 의료영상 판독용 인공지능을 개발한 것은 연구진이 세계 최초입니다. 연구팀은 적대적 예제를 통해 실제로 녹내장 소견이 변화한 것을 확인했습니다. 또한 안과 의사를 대상으로 한 설문조사 결과 적대적인 설명을 이용하는 것은 기존의 방법보다 인공지능을 더 잘 이해하는 데 도움이 된다고 합니다.

연구진이 개발한 설명가능 AI는 인공지능이 왜 녹내장으로 진단되었는지를 설명할 수 있기 때문에 뛰어난 임상적 활용도로 의료현장에 도입될 것으로 기대되고 있습니다.

기존의 인공지능은 의사결정을 지원하면서 결과만 전달하고, 어떤 근거로 이 판단에 이르렀는지 그 이유를 논리적으로 설명하지 못하는 점이 한계로 지적되었습니다. 최근 인공지능의 발전으로 의료영상 이미지에 의한 녹내장 진단 AI가 개발되고 있으나, 의료현장 도입이 어려웠기 때문입니다. 인공지능의 특성상 내부구조나 작동원리를 밝히기 어려웠기 때문입니다.단순히 진단의 정확도를 높이는 AI 기술뿐만 아니라 안과 의사들이 이해할 수 있도록 설명하는 인공지능을 개발하는 것이 매우 중요합니다.서울대학교병원 장주영 연구원(1저자)이 이번에 개발한 AI 설명방법론은 병변의 위치만을 나타내는 기존 히트맵(Heatmap) 방식보다 높은 설명력을 가지고 있으며, 녹내장 진단을 내린 의학적 소견도 함께 제시합니다.서울대병원 안과 박기호 교수님, 기존에 AI가 가지고 있던 블랙박스 문제를 해결한 새로운 설명 가능 AI 기술은 신뢰성을 높여 향후 인공지능 의료기기의 인증과 사용성을 확대하는 데 중요한 원천기술입니다. 이를 기반으로 인간과 AI의 상호 의사소통을 촉진하는 인공지능 의료기기를 개발할 예정입니다.서울대병원 가정의학과 박상민 교수

서울대병원과 인더스마트(주)의 협력 연구로 진행된 이 논문은 안과학 분야에서 국제적으로 가장 권위 있는 미국안과학회(AAO)의 공식 학술지 옵살몰로지 최근호에 실렸습니다.

사진 왼쪽부터 안과 박기호 교수, 가정의학과 박상민 교수, 제1저자 장주영 연구원.